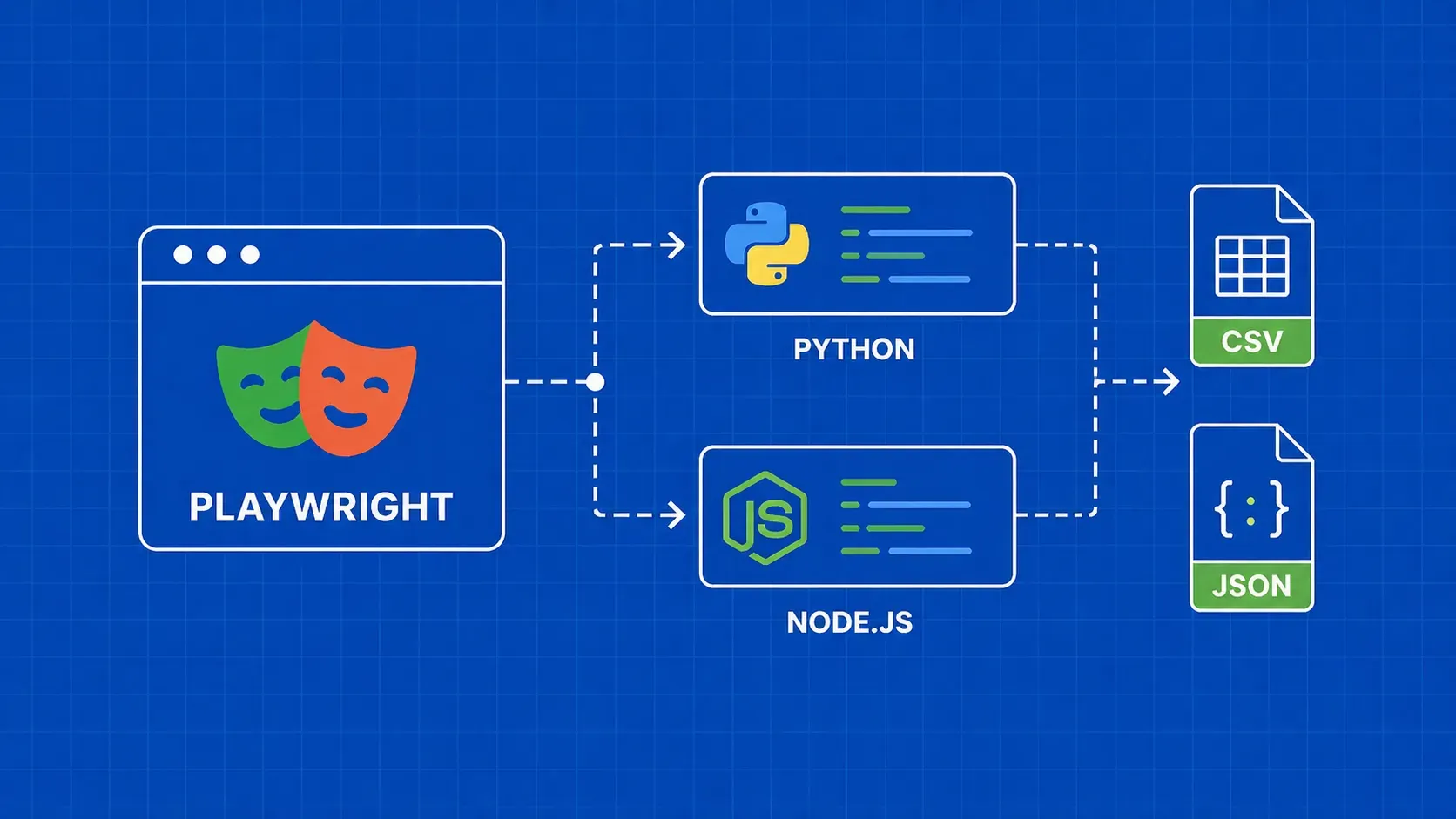

En bref : Playwright vous offre une automatisation complète du navigateur pour l'exploration de sites riches en JavaScript, avec une prise en charge optimale de Python et de Node.js. Ce guide vous explique pas à pas l'installation, l'extraction d'éléments, la configuration d'un proxy, les techniques anti-détection, la pagination, le téléchargement d'images et l'exportation de données au format CSV ou JSON, le tout accompagné d'exemples de code côte à côte dans les deux langages.

Si vous avez déjà essayé de scraper une application moderne à page unique avec un simple client HTTP, vous connaissez déjà le problème : le code HTML que vous obtenez est une coquille vide, et les données que vous recherchez se trouvent dans du JavaScript qui ne s'exécute jamais. Le web scraping avec Playwright résout ce problème en pilotant un véritable navigateur (Chromium, Firefox ou WebKit) par programmation, ce qui permet à votre script de voir exactement ce qu'un visiteur humain verrait.

Playwright est un framework open source d'automatisation de navigateur maintenu par Microsoft. Contrairement aux anciens outils, il intègre d'emblée des fonctionnalités d'attente automatique, d'interception réseau et la prise en charge de plusieurs moteurs de navigateur. Que vous écriviez en Python ou en Node.js, l'interface API est pratiquement identique, vous pouvez donc choisir le langage qui correspond le mieux à votre pile technologique.

Ce guide couvre tout ce dont vous avez besoin pour passer d'un terminal vierge à des scripts de scraping Playwright prêts pour la production : configuration, sélecteurs, extraction de texte et d'images, pagination, interception de requêtes, configuration de proxy, techniques de dissimulation, gestion des erreurs et exportation de données structurées. Chaque technique inclut du code pour Python et Node.js.