En bref : Puppeteer vous offre un contrôle total sur une instance de Chrome sans interface graphique depuis Node.js, ce qui en fait l'outil incontournable pour le scraping de pages rendues en JavaScript. Ce guide vous explique pas à pas l'installation, l'extraction à l'aide de sélecteurs, le défilement infini, la connexion via des formulaires, l'interception de requêtes, les plugins de dissimulation, l'exportation de données structurées et le déploiement avec Docker, afin que vous puissiez passer d'un simple script d'essai à un scraper prêt pour la production.

Le web scraping consiste à extraire des données de sites web par programmation. Lorsque ces sites s'appuient sur du JavaScript côté client pour afficher leur contenu, une simple requête HTTP ne suffit pas. Vous avez besoin d'un véritable navigateur, ou au moins d'un outil qui s'y ressemble. C'est exactement le problème que Puppeteer a été conçu pour résoudre.

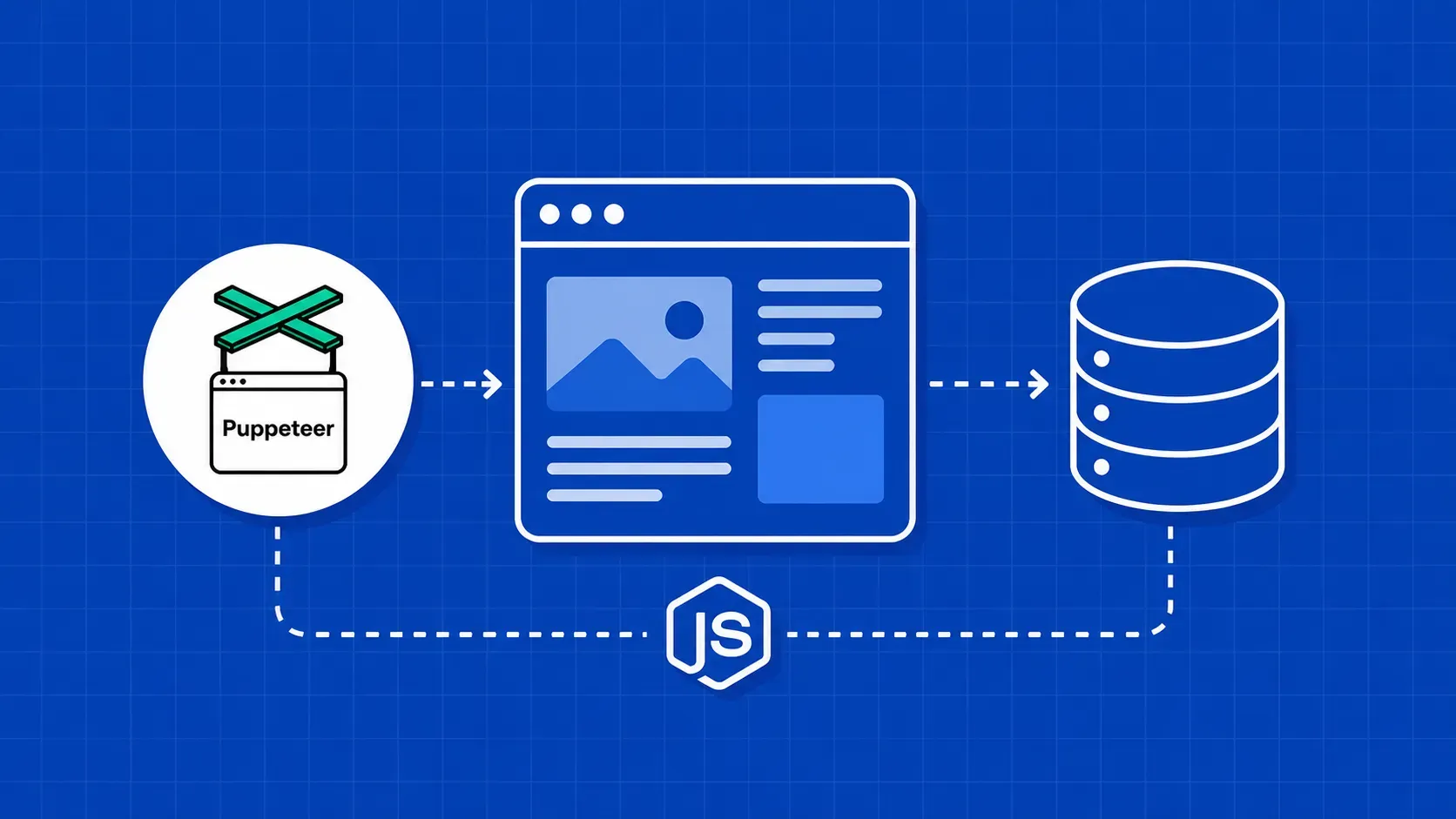

Puppeteer est une bibliothèque Node.js qui vous permet de faire du web scraping avec Puppeteer et NodeJS en pilotant une instance Chrome sans interface graphique (ou avec interface graphique) via le protocole Chrome DevTools. Elle peut cliquer sur des boutons, remplir des formulaires, faire défiler des pages et évaluer du code JavaScript arbitraire dans le contexte de la page, puis renvoyer les résultats à votre script. Pour les développeurs déjà à l'aise avec JavaScript, c'est l'une des voies les plus naturelles pour aborder les workflows de scraping avec un navigateur sans interface graphique.

Dans ce tutoriel, vous apprendrez à configurer un projet Puppeteer à partir de zéro, à extraire des données de pages statiques et dynamiques, à gérer la pagination et le défilement infini, à intercepter les appels API cachés, à éviter la détection des bots, à exporter vos résultats au format JSON et CSV, et à déployer l'ensemble dans un conteneur Docker. Tous les exemples de code ciblent Node.js 18 ou une version ultérieure, et nous faisons référence à l'interface API de Puppeteer v24 tout au long du guide. Que vous développiez un outil de suivi des prix, un pipeline de génération de prospects ou un outil de recherche universitaire, les modèles présentés dans ce guide vous permettront de passer plus rapidement en production.